腾讯混元开源首款混合推理MoE模型

原创2025年6月27日,腾讯混元宣布开源其首款混合推理MoE模型——Hunyuan-A13B,这一举措标志着腾讯在人工智能领域的技术创新与开放共享迈出了重要一步。

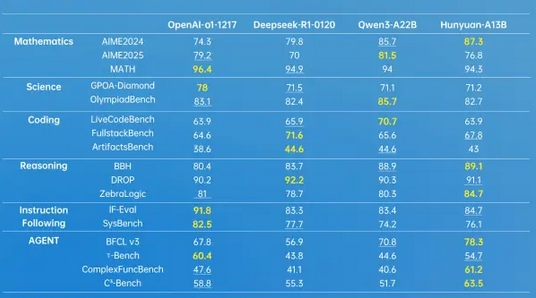

Hunyuan-A13B作为业界首个13B级别的MoE开源混合推理模型,总参数高达80B,但激活参数仅13B,实现了性能与效率的完美平衡。该模型基于先进的MoE架构,通过动态路由机制将输入数据分配给不同的专家子模型进行处理,从而显著提升了模型的通用能力和推理速度。

在多个业内权威数据测试集上,Hunyuan-A13B均取得了优异成绩,尤其在Agent工具调用和长文理解方面表现出色。它支持256K原生上下文窗口,能够处理更长的文本输入,并在多个长文数据集中取得了优异成绩。此外,Hunyuan-A13B还提供了快思考和慢思考两种模式,用户可根据需求灵活切换,以在效率和准确性之间取得平衡。

目前,Hunyuan-A13B已在Github和Huggingface等开源社区上线,同时模型API也在腾讯云官网正式上线,支持快速接入部署。这一开源举措将极大地降低开发者使用先进AI技术的门槛,推动AI技术的普及和应用。腾讯混元将继续秉持开放共享的理念,为AI技术的发展贡献更多力量。

版权声明

本文仅代表作者观点,不代表AI资讯汇立场。

本文系作者授权AI资讯汇发表,未经许可,不得转载。

AI资讯汇

AI资讯汇