谷歌DeepMind发布本地化机器人AI模型,离线操作精度达毫米级

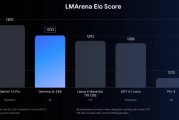

原创6月25日,谷歌DeepMind团队发布全球首个完全在机器人本地运行的视觉-语言-动作(VLA)模型“Gemini Robotics On-Device”。该模型无需依赖云端计算,可在网络不稳定或零连接环境下稳定工作,响应延迟低于100毫秒,适用于工业制造、生活等场景。

“Gemini Robotics On-Device”基于Gemini 2.0架构,支持从人形机器人到工业双臂机器人的多种本体部署。在测试中,该模型成功完成系鞋带、叠衣服、打开包袋拉链等高精度任务,且在分布外任务(如操作训练时未见过的物体)中表现优异。谷歌团队透露,开发者仅需50到100个演示样本,即可让模型适应新任务,并支持跨平台迁移。例如,在ALOHA机器人上训练的模型,可直接部署到Franka FR3工业机器人上完成皮带装配任务。

为保障安全,该模型采用语义安全和物理安全并重的方案,通过Live API实时捕获语义和内容安全问题,并与底层安全关键控制器接口联动。目前,“Gemini Robotics On-Device”已通过可信测试者计划开放SDK申请,开发者可利用MuJoCo物理模拟器进行测试,降低开发成本。

版权声明

本文仅代表作者观点,不代表AI资讯汇立场。

本文系作者授权AI资讯汇发表,未经许可,不得转载。

AI资讯汇

AI资讯汇